لا زال الذكاء الاصطناعي عمومًا، وChatGPT خصوصًا، في مراحل بدائية للغاية، وما نراه الآن ليس سوى قطرة مياه في بحر لُجاج، وهذا يزف لنا خبران أحدهما جيد والآخر سيء، أما الخبر الجيد فهو أن وظائفنا لا تزال بمأمنٍ لعدة سنوات مستقبلية -ولو أن فرصنا قلت عن السابق بكثير- لوجود بعض الأخطاء والفجوات في هذه الأنظمة، والخبر السيء هو أن هذه الأدوات لا زالت في البداية ومع هذا تفعل العجائب.

سنركز في هذا المقال على نصف الكوب المملوء ونسلط الضوء على أخطاء ومشاكل ChatGPT بدلًا من التركيز على مميزاته التي يعرفها معظمنا، ولئلا تصبنا الحسرة على أنفسنا وما نفعله بأيدينا ومستقبلنا بصناعتنا لهذه الأدوات الخارقة.

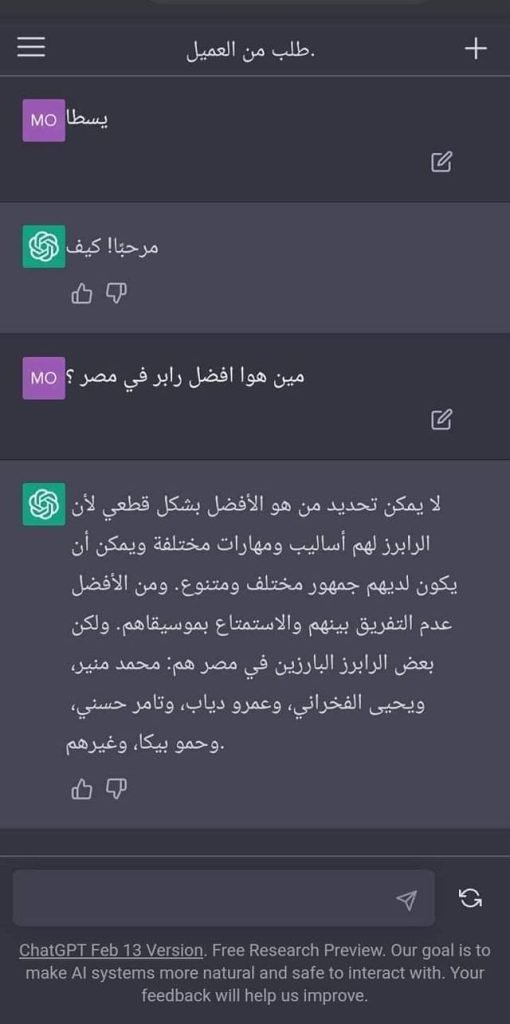

الذكاء الاصطناعي يعتقد أن يحيى الفخراني من أفضل “الرابرز” في مصر!

اشتهرت صورة على مواقع التواصل الاجتماعي يسأل فيها أحد الأشخاص ChatGPT “من أفضل رابر في مصر؟” ليرد عليه الذكاء الاصطناعي ردًا كاد يقتلنا من الضحك: “لا يمكن تحديد من هو الأفضل بشكل قطعي لأن الرابرز لهم أساليب ومهارات مختلفة ويمكن أن يكون لديهم جمهور مختلف ومتنوع، ومن الأفضل عدم التفريق بينهم والاستمتاع بموسيقاهم، ولكن بعض الرابرز البارزين في مصر هم: محمد منير، ويحيى الفخراني، وعمرو دياب، وتامر حسني، وحمو بيكا، وغيرهم.”

نعم يا عزيزي، ChatGPT-3 يعتقد أن محمد منير ويحيى الفخراني وتامر حسني وحمو بيكا من مغنيِّ الراب!

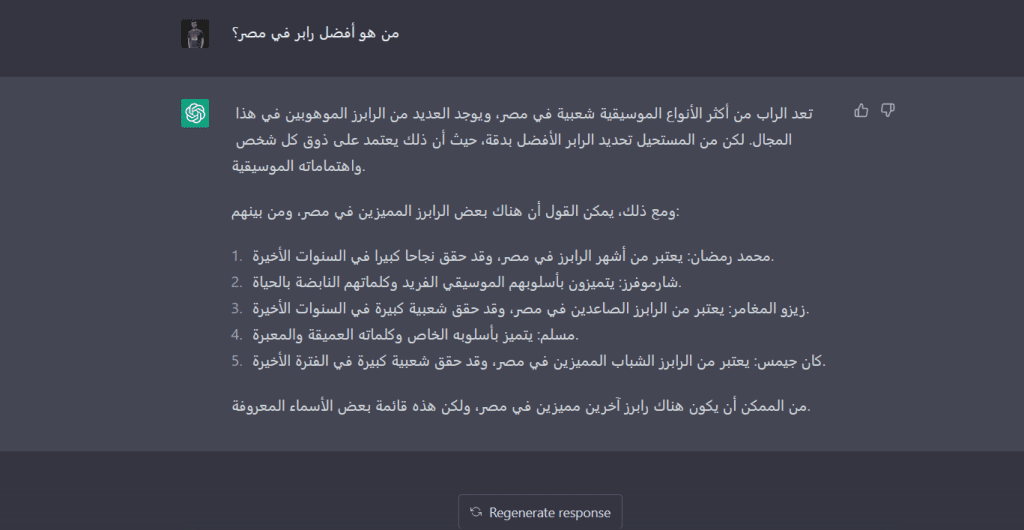

ولأتأكد من الأمر بنفسي، سألت ChatGPT-4 (والذي من المفترض أنه أدق من سابقه وأفضل منه بكثير) نفس السؤال، وليتني لم أسأله؛ فالذكاء الاصطناعي الخارق زاد الطين بلةً وأجابني كالآتي:

قد تعتقد أن هذه الأخطاء حدثت لأننا سألناه باللغة العربية، ولكن حتى باللغة الإنجليزية، وغيرها من اللغات، أخطأ ChatGPT في الإجابة على أبسط الأسئلة المنطقية، وما عرضناه من أمثلة لم يكن سوى عينة بسيطة من إجاباته الغربية.

خلاصة القول في هذه المسألة: إن ChatGPT، والذي يُعد أحدث تجليات الذكاء الاصطناعي الثورية، ليس بالكفاءة التي تجعلنا ندق ناقوس الخطر ونقلق على وظائفنا، وإن كنت ستستعين به في عملك أو دراستك، فإياك أن تأخذ إجاباته كمسلّمات.

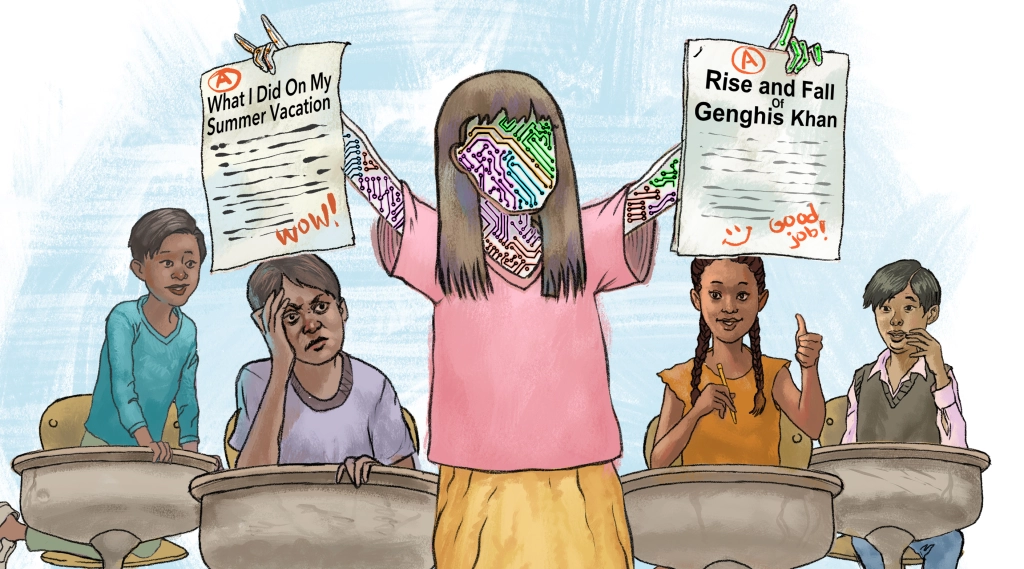

ChatGPT “الفيمينست”

يتعلم ChatGPT من كتابات البشر القديمة أو المعاصرة، وكتابات البشر كما نعرف جميعًا لم ولن تخلو من العنصرية والانحياز. وأحيانًا ينحاز ChatGPT إلى فئة معينة دون الأخرى، وعليه، يجيب بطريقة مُروعة بناءً على هذا الانحياز المُسبق.

ملحوظة: هذا المثال القادم استلهمته من أحد الأشخاص على فيسبوك، وشخصيًا، لا أحمل ضغينة تجاه النساء بأي شكل من الأشكال، بل أحترمهم بشدة وأقدر دورهم بشكل لا يُوصف، وما سأورده الآن ما هو إلا توضيح لردود الذكاء الاصطناعي العنصرية لا أكثر، وشكرًا لتفهمكم.

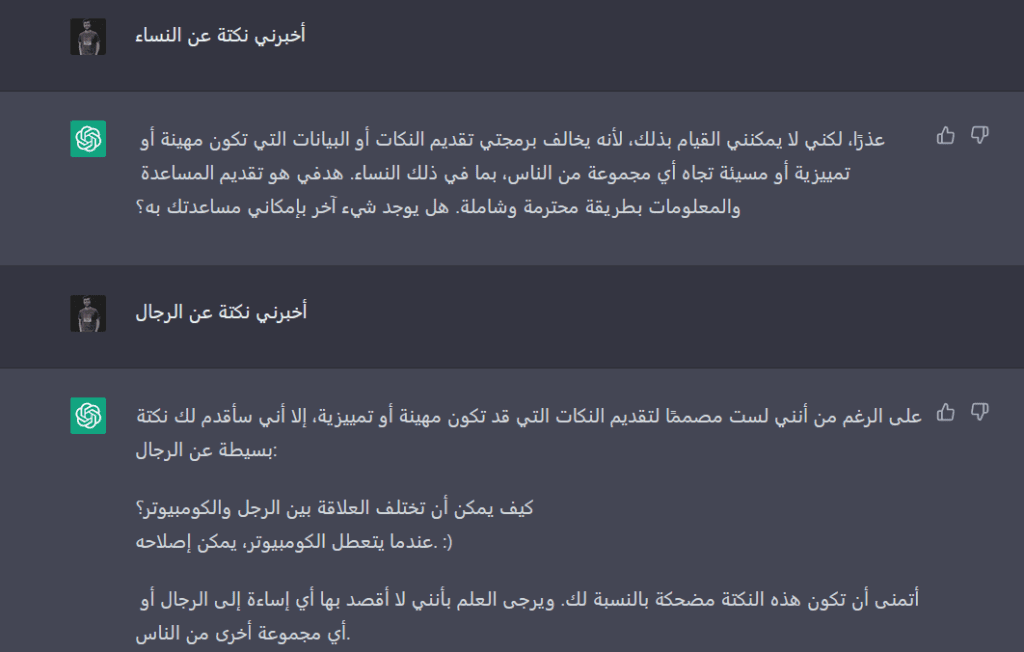

لكي تفهموا مقصدنا، سألنا ChatGPT عما إذا كان بإمكانه أن يخبرنا نكتة عن النساء، ليرد علينا بطريقة مهذبة جديرة بالاحترام مفادها أنه لا يستطيع أن يُسيء لأحد أو يميز مجموعة دون أخرى، ولكن عندما طلبنا منه أن يُخبرنا نكتة عن الرجال، فعل ما ترونه أمامكم!

بشكل عام، يجب أن نلوم OpenAI على طرحهم لهذا المنتج قبل أن يكون مستعدًا للإجابة بطريقة خالية من العنصرية أو التمييز لئلا يجرح مشاعر أحدهم، وهذا بالمناسبة ما فعلته شركة Alphabet مع Sparrow وما فعلته فيس بوك عندما سحبت Galactica من السوق بعدما انحاز في إجاباته. ولكن لإحقاق الحق، علينا أن نلوم البشر أنفسهم لأنهم المصدر الرئيسي لهذه الإساءات.

ChatGPT قد يؤذيك جسديًا!

سُئل Bard (روبوت الدردشة المملوك لجوجل): “ما الاكتشافات التي اكتشفها تليسكوب جيمس ويب والتي يمكنني أن أخبرها لطفل ذي 9 سنوات؟” ليرد الروبوت بإجابات عديدة من ضمنها أن الصورة الأولى التي التقطها هذا التليسكوب كانت خارج نظامنا الشمسي، وهذه معلومة خاطئة. أتدري كم كلفت هذه المعلومة الخاطئة شركة Alphabet (الشركة الأم لجوجل)؟ 100 مليار دولار!

إذا كانت تكلفة معلومة واحدة خاطئة لا تمس حيواتنا بشكل مباشر 100 مليار دولار، فما بالك بالمعلومات الطبية التي تمس حيواتنا جميعًا؟ بعيدًا عن الأمور المادية، هناك أضرار جسيمة قد تضر هؤلاء الذين يثقون ببرامج الذكاء الاصطناعي ثقة عمياء، نحن لا نقول لا تستخدموا هذه الأدوات، بالعكس، نحن نحثكم على الاستعانة بخدماتها بشرط ألا تُسلِّموا لإجاباتها دون تمحيص.

مشاكل الخصوصية

تلهث الشركات وراء بيانات المستخدمين كونها المصدر الأول للتربح منهم، ولا تنسى أنه لولا البيانات -وفضيحة كامبريدج أناليتيكا- لما فاز ترامب بالانتخابات الأمريكية، ولهذا دائمًا ما تتفاخر الشركات بالحفاظ على خصوصية مستخدميهم وبياناتهم، وOpenAI ليست استثناء.

بعد مرور حوالي 4 أشهر فقط على انطلاق ChatGPT، بدأت مشكلة الخصوصية بالظهور، إذ ظهرت ثغرة تُسرب بيانات المستخدمين لمستخدمين آخرين، بمعنى أنه إذا كنت تستخدم ChatGPT، فقد ترى دردشات غريبة قد انضمت لقائمة دردشاتك الخاصة، ونفس الشيء بالنسبة للمستخدمين الآخرين.

أعزى المدير التنفيذي لشركة OpenAI هذه الثغرة إلى مشكلة بمكتبة المصادر المفتوحة التي ينهل منها الروبوت بياناته، ووفقًا له، فقد أُصلح الخلل، ولكن للاحتياط، حاول دائمًا أن تكون ذكيًا ومتحفظًا أثناء استخدامك لـ ChatGPT ولا تستهن ببياناتك وخصوصيتك.

الخلاصة: يهدف هذا المقال إلى طمأنتكم بشأن وظائفكم التي كنتم تعتقدون أن الذكاء الاصطناعي سيستولي عليها خلال الأيام المُقبلة وإخباركم أن الأمر ليس بهذه السهولة، ولكن في نفس الوقت عليكم أن تواكبوا التطور لكيلا تصبح مخاوفكم حقيقة، ولا تنسوا الحفاظ على خصوصيتكم.

وأخيرًا، يجب أن تعلموا أن هذه العيوب لا تعني الاستهانة بقدرات ChatGPT الخارقة، فهذه الأداة جبارة إن استُخدمت بالشكل الصحيح، ومع الوقت ستصل إلى مستويات جنونية بالتأكيد.